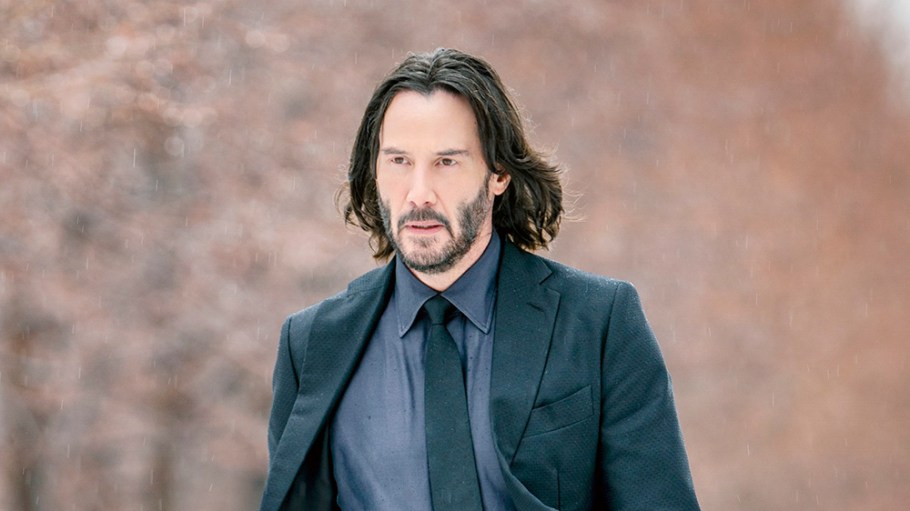

Video Palsu

Kini teknologi aplikasi kamera menjadi semakin canggih. Pengguna aplikasi dapat memanfaatkan aplikasi yang ada untuk memanjangkan kaki, menghilangkan jerawat, menambah telinga binatang, dan bahkan sekarang dapat membuat video palsu yang terlihat sangat nyata.

Ket.

Doc: istimewaTeknologi yang digunakan untuk membuat konten digital dengan instan yang dikenal dengan sebutan "deepfakes" itu, kini telah dapat diakses oleh massa. Deepfakes merupakan video hasil manipulasi, atau representasi digital lain yang dihasilkan oleh kecerdasan buatan canggih, yang menghasilkan gambar dan suara palsu yang tampak nyata.

"Video-video semacam itu menjadi semakin canggih dan mudah diakses. Deepfakes mengangkat serangkaian kebijakan, teknologi, dan masalah hukum yang menantang," tulis peneliti dari Center for Technology Innovation, di Washington, Brookings Institution, John Villasenor.

Villasenor, yang juga seorang pakar teknik elektro dari University of California, Los Angeles ini menambahkan, bahkan setiap orang yang memiliki komputer dan akses internet secara teknis dapat membuat konten deepfake. Istilah deepfake merupakan gabungan kata "belajar mendalam" dan "palsu," dan merupakan bentuk kecerdasan buatan.

Menurut pakar hukum dari Universitas New York, Paul Barrett, dalam istilah sederhana, deepfake adalah video palsu yang dibuat dengan cara belajar yang mendalam.

"Pembelajaran mendalam adalah "subset AI," dan mengacu pada pengaturan algoritma yang dapat mempelajari dan membuat keputusan cerdas sendiri," ujarnya.

"Tapi teknologi itu berbahaya karena dapat digunakan untuk membuat orang percaya bahwa sesuatu itu nyata ketika tidak ada," kata ahli strategi keamanan dunia maya dan pertahanan, yang bekerja di lembaga think tank New America, Peter Singer.

Anda mungkin tertarik:

Singer bukan satu-satunya yang memperingatkan potensi bahaya deepfakes. Villasenor mengatakan kepada CNBC bahwa teknologi itu dapat digunakan untuk merusak reputasi seorang kandidat politik, dengan membuatnya terlihat mengatakan atau melakukan hal-hal yang tidak pernah benarbenar terjadi.

"Ini adalah alat baru yang kuat bagi mereka yang mungkin ingin membuat informasi yang salah untuk mempengaruhi pemilihan," kata Villasenor.

Sistem pembelajaran yang mendalam dapat menghasilkan tiruan yang tampak persuasif dengan mempelajari foto dan video seseorang yang menjadi target dari berbagai sudut, dan kemudian meniru perilaku dan pola bicara orang itu. Barrett menjelaskan bahwa begitu pencitraan palsu awal telah dibuat, metode yang dikenal sebagai GAN, atau jaringan saraf tiruan yang bertujuan untuk membentuk atau membangkitkan suatu data yang benar-benar baru, dari tidak ada menjadi ada, membuatnya lebih dapat dipercaya.

"Proses GAN berupaya untuk mendeteksi kekurangan dalam pemalsuan, yang mengarah ke perbaikan mengatasi kekurangan. Setelah beberapa putaran deteksi dan dilakukan peningkatan, video deepfake selesai," kata dia.

Menurut laporan teknologi MIT, perangkat yang memungkinkan deepfake dapat menjadi senjata yang sempurna untuk pemasok berita palsu yang ingin memengaruhi segala hal, mulai dari harga saham hingga pemilihan umum.

"Faktanya, perangkat AI telah digunakan untuk meletakkan gambar wajah orang lain di tubuh bintang porno dan menaruh kata-kata di mulut para politisi," tulis Kepala Biro San Francisco MIT Technology Review, Martin Giles, dalam sebuah laporan.

Bagaimana cara mendeteksi video yang dimanipulasi. Villasenor menjelaskan, selain dapat digunakan untuk membuat deepfakes, teknologi AI juga dapat digunakan untuk mendeteksi video palsu.

Dengan teknologi yang dapat diakses oleh pengguna komputer mana pun, semakin banyak peneliti yang berfokus pada deteksi deepfake dan mencari cara untuk mengaturnya.

Perusahaan besar seperti Facebook dan Microsoft telah mengambil inisiatif untuk mendeteksi dan menghapus video deepfake. Menurut Reuters, awal tahun ini kedua perusahaan itu telah mengumumkan bahwa mereka akan berkolaborasi dengan universitas-universitas terdepan di AS untuk membuat bank data besar video palsu untuk penelitian.

"Saat ini, ada beberapa aspek visual yang tidak aktif jika Anda melihat lebih dekat, apa pun dari telinga atau mata yang tidak cocok dengan batas kabur wajah atau kulit terlalu halus untuk pencahayaan dan bayangan," kata Singer. Namun dia mengatakan bahwa sekarang semakin sulit untuk mendeteksi "Tell" karena teknologi deepfake menjadi lebih maju dan video terlihat lebih realistis. CNBC/SB/R-2